Una escena captada en video dentro de Palacio Nacional detonó una cadena de versiones oficiales contradictorias que culminaron con la confirmación presidencial de un hecho previamente negado.

LEE ADEMÁS: Pago de tenencia y refrendo 2026 en CDMX y Edomex: fecha límite, dónde pagar y evitar recargos

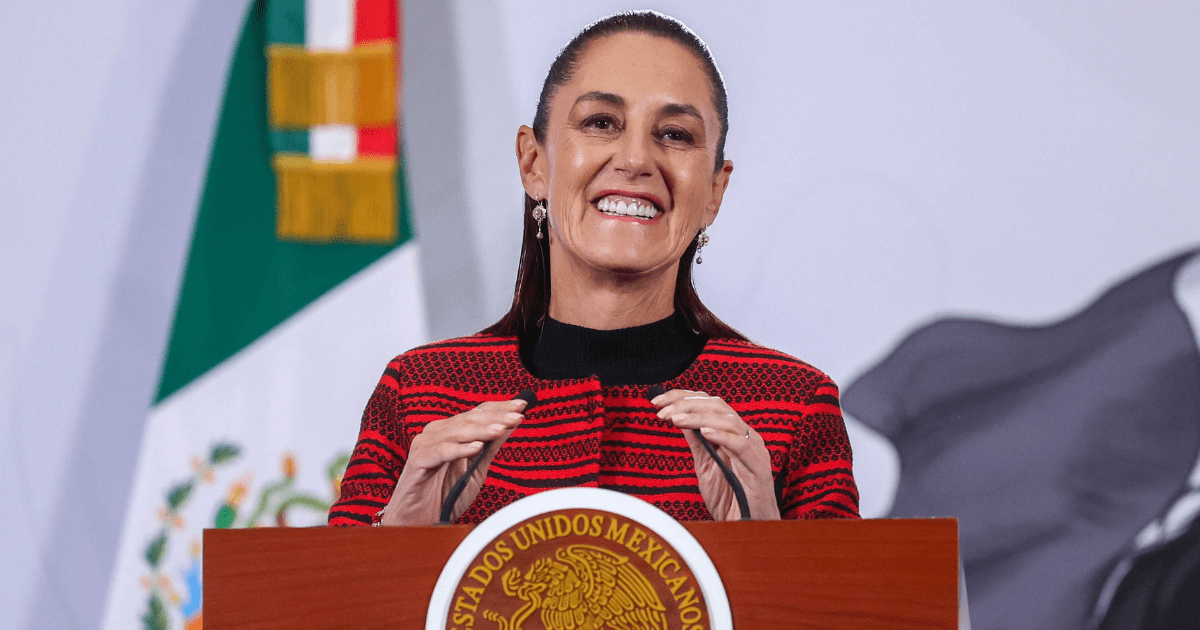

Durante la conferencia matutina de este lunes, la presidenta Claudia Sheinbaum admitió que una persona sí se sentó a tomar el sol en una ventana, luego de que áreas internas aseguraran inicialmente que no existía registro del incidente.

La mandataria explicó que, tras solicitar información, primero se reportó que “nunca nadie había salido a tomar el sol”, pero una revisión posterior corrigió el dato: “sí había habido una persona”, lo que obligó a ajustar la postura institucional.

El caso cobró relevancia por la intervención de Infodemia, que desestimó el video al señalar que tenía indicios de ser contenido generado con inteligencia artificial, argumento que fue desmentido por la confirmación presidencial.

Sheinbaum sostuvo que la persona involucrada fue sancionada y se le indicó que no podía repetir la conducta, aunque subrayó que no existe una norma explícita que lo prohíba.

“No está prohibido per se, pero hay que tener respeto por lo que significa Palacio Nacional como patrimonio histórico”, afirmó la presidenta.

La resolución dejó inconsistencias en el criterio institucional, ya que se reconoció la ausencia de prohibición formal, pero se aplicó una sanción administrativa.

El episodio se viralizó en redes sociales, aumentando la presión pública y evidenciando fallas en la narrativa oficial.

La secuencia —negación inicial, desmentido técnico y confirmación final— colocó en el debate la confiabilidad de la comunicación gubernamental.

El caso también expuso los riesgos de depender de herramientas automatizadas para detectar inteligencia artificial, sin una verificación directa adecuada.